Как улучшить онлайн-репутацию с помощью Serpstat

О проекте

OSINT — это использование возможностей открытых источников информации, доступных в интернете, на максимальную мощность. Различие между простым поиском в сети и OSINT'ом в глубине подхода — нельзя изучить рацион глубоководных рыб, наблюдая за рябью на поверхности океана.

У нас нет опубликованных кейсов, так как большая часть наших клиентов — люди публичные, и мы работаем строго по NDA. Никто из наших клиентов не знает, с кем мы работаем сейчас, и с кем работали ранее. Наша команда хорошо разбирается в алгоритмах работы сетей, сайтов, роботов, поисковых систем.

Из чего состоит работа

Мое последнее высшее образование я получал в Академии Госуправления на кафедре информационной политики (связи с общественностью), и моя курсовая работа и часть диплома была на тему «Информационные войны». Поэтому мой опыт в маркетинге дополняется пониманием информационных войн и управления массами. Для сбора информации используем большой список источников. Количество источников информации чаще всего в проектах не ограничено.

По возможности используем все категории:

Глубина поиска всегда непредсказуема. Так как, найдя определенный контент, мы можем углубиться в найденное, а потом в найденном углубится еще дальше. Помните фильм «Начало»? Там, где главные герои вводили человека в сон, потом во сне вводили еще в один сон, а в финале фильма они смогли перейти и на 3-й уровень сна. Вот примерно так же в работе с репутацией, когда необходимо через OSINT находить следы черного PR, и создавать способы борьбы с ним.

Возьмем, к примеру, один из наших кейсов. Назовем его «Тарас Тарасович». И вот Тарас Тарасович (далее ТТ) обращается к нам с просьбой помочь с репутацией. При первом срезе мы находим огромное количество контента с черным оттенком, направленного на очернение репутации в сети. Примерно 95% всей информации о ТТ — негативная.

Информации много и разной, на разных каналах и в разное время написанная. Мы также сразу понимаем, что создана целая PR-кампания, кем-то финансируемая и с конкретными целями на результат.

Наша задача — изменить 95% негативной выдачи на 95% позитивной, или, в худшем случае, — на нейтральную. В первом блоке работы, напомню, у нас сбор информации. То есть мы начинаем искать (всеми возможными способами) любое упоминание на 3-х языках (русский, украинский, английский) о человеке ТТ. В результате появляется файл с огромным количеством ссылок на тот или иной контент, где есть упоминание.

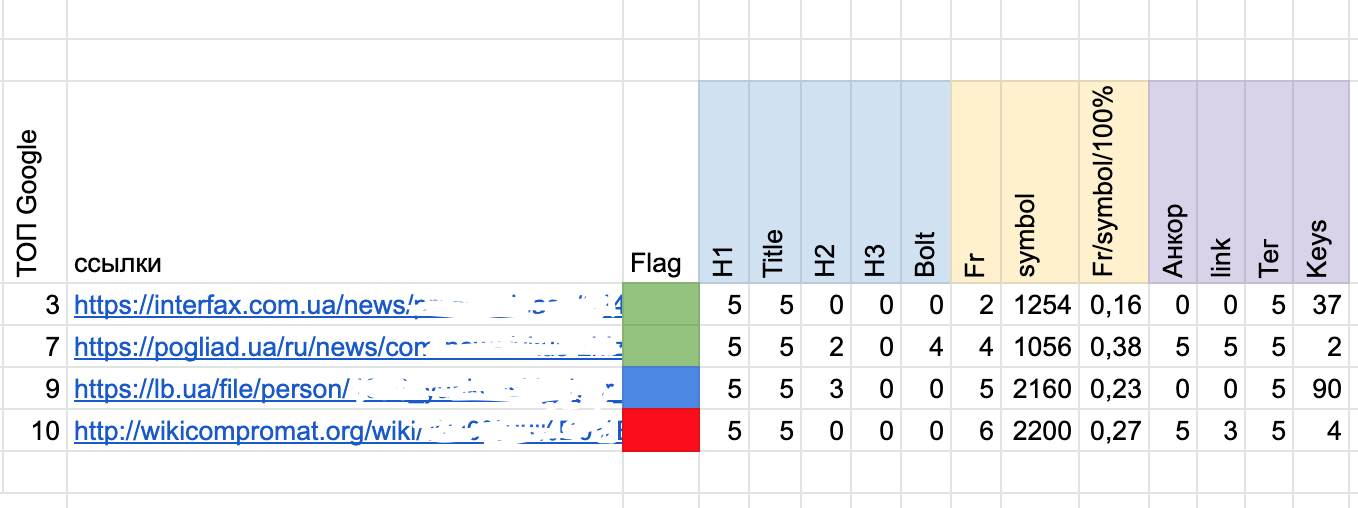

Все результаты мы разбиваем по категориям — сайт, соц. сеть, блог, видео и т.д. Ставим возле каждой ссылки оттенок негатива по пятибалльной шкале. К примеру, если в заголовке H1 и/или тайтл есть наш ТТ — то это максимальный балл — 5. Если заголовок не о нем, но в тексте упоминается ТТ 1−2 раза косвенно и без разметки — это 1-2 балла. Если ФИО ТТ выделен жирным, проставлен тег или анкор — это 3−4.

Способы составления этого файла постоянно меняются, добавляем новые критерии, новые функции и оттенки. Технологии не стоят на месте, поэтому каждый проект получает все последние инсайты и технологии, внедренные на предыдущих проектах.

Анализ сайта

Что у нас есть на старте:

и так далее.

Такие сайты сразу уходят в мой топ-10 по этому проекту. Но здесь важно не упустить и другие уровни, и копнуть еще дальше — на 3-й уровень. Ведь моя задача не найти все ссылки, а выявить закономерность в их появлении, хронологии, ключевых словах.

Если работают профи в черном PR, то они это делают системно, по четкому плану. И чем быстрее я выясню этот план (хотя бы его гипотезы), тем быстрее я сформирую защиту и противодействие.

2-й уровень — это чаще всего нишевый (сателлит или один из доменов «группы сайтов», который ссылается на 1-й.

Моя задача — копать дальше. Искать и, возможно, найти следующие уровни 3-й, 4-й и так далее.

В этом случае чем больше глубина, тем ближе этот сайт к 1-му месту в моей таблице топ-10 проекта ТТ.

Заказывайте бесплатную персональную демонстрацию сервиса, и наши специалисты вам все расскажут! ;)

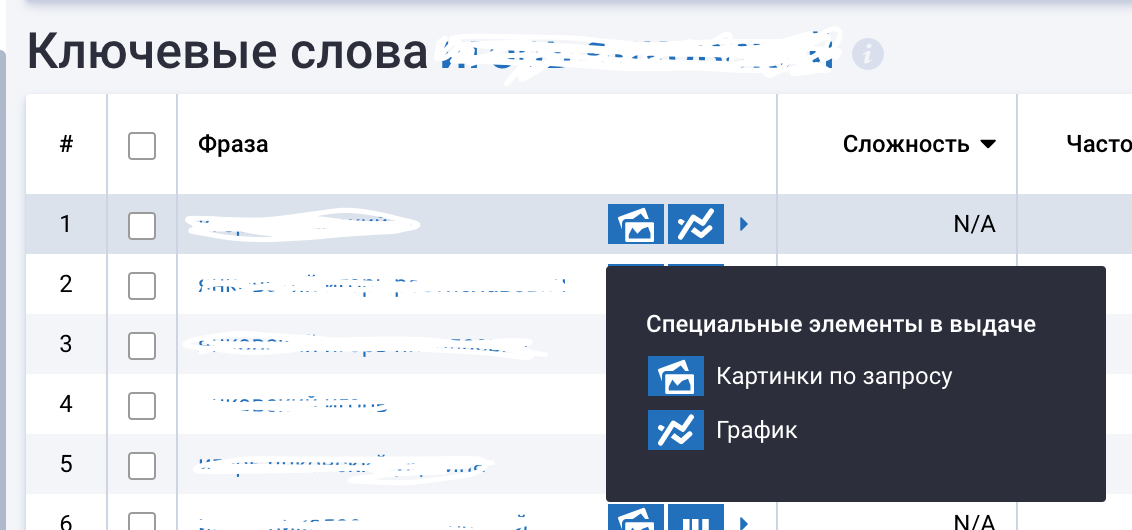

Анализ контента

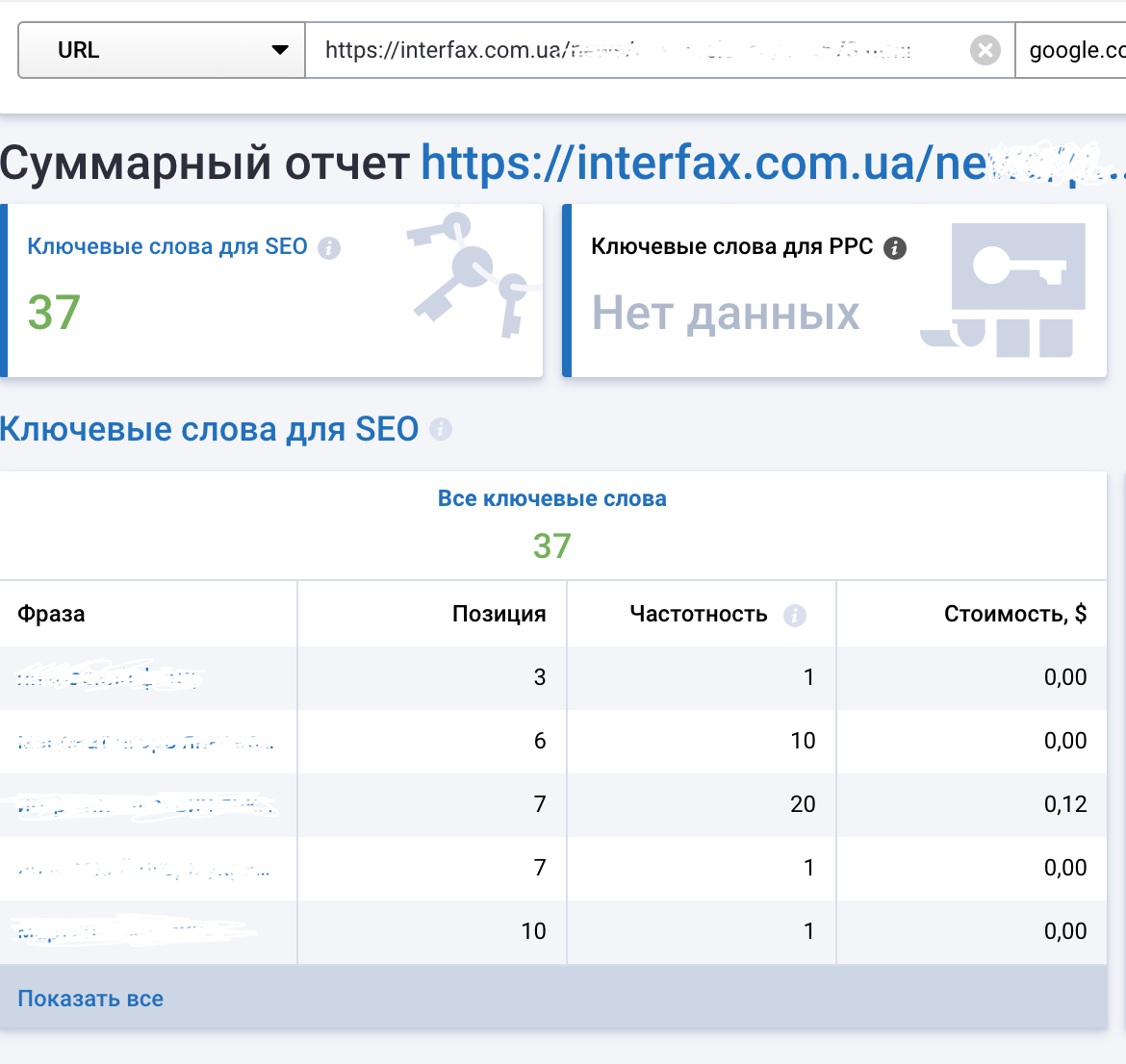

В отдельном списке записываем сайты в хронологическом порядке. Таким образом, находим сайты, на которых были самые первые публикации по времени. Берем оттуда ключевые словосочетания (иногда целые предложения) и гуглим на их повтор. Находим сайты, которые перепечатали часть или полный текст — и записываем их в рабочую таблицу. Далее все эти сайты снова идут в Serpstat для анализа.

Также с помощью инструмента с контентом изучаем количество вхождений H1/H2/H3 и составляем гипотезу, которая нам дает понимание причин попадания именно этой страницы в топ-10 выдачу в Google. Ведь, напомню, у нас задача — убрать 95% негатива.

При этом личного сайта или блога у ТТ нет, у него есть только пару аккаунтов в социальных сетях. А нам надо бороться с целыми новостными сайтами с миллионным трафиком. Поэтому уже через месяц работы мы запустили сайт с нуля — как личный блог нашего ТТ. После анализа всех 100 найденных страниц 1-го уровня у нас с помощью Serpstat будет:

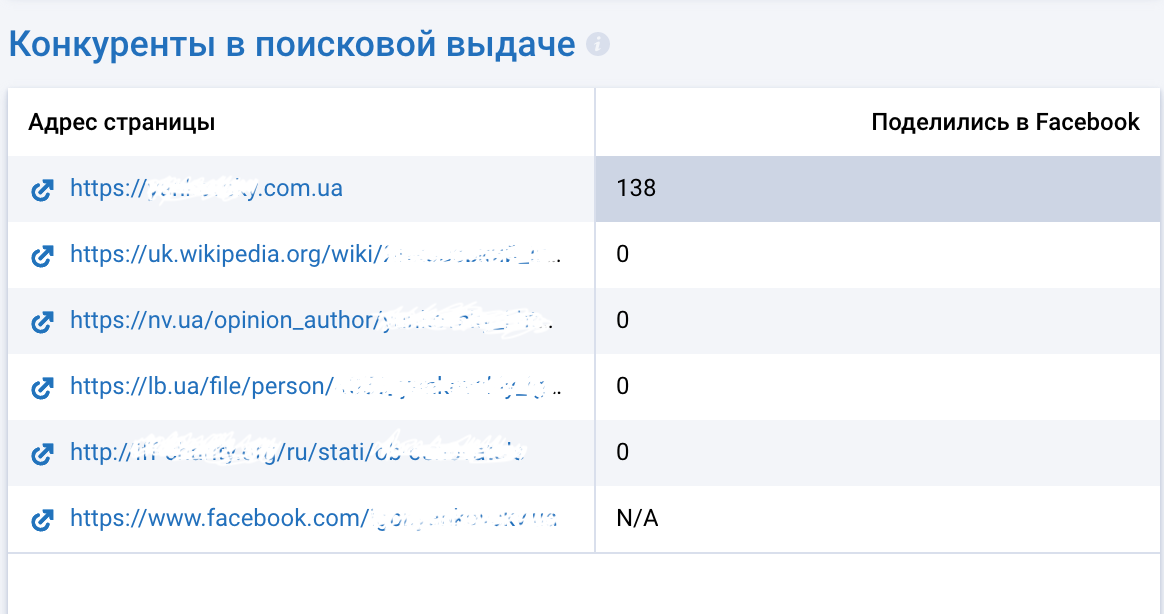

Не забываем проверить и социальные домены при анализе по ключевой фразе. Так как наличие в конце таблицы иконки Wikipedia дает нам сигнал к действию:

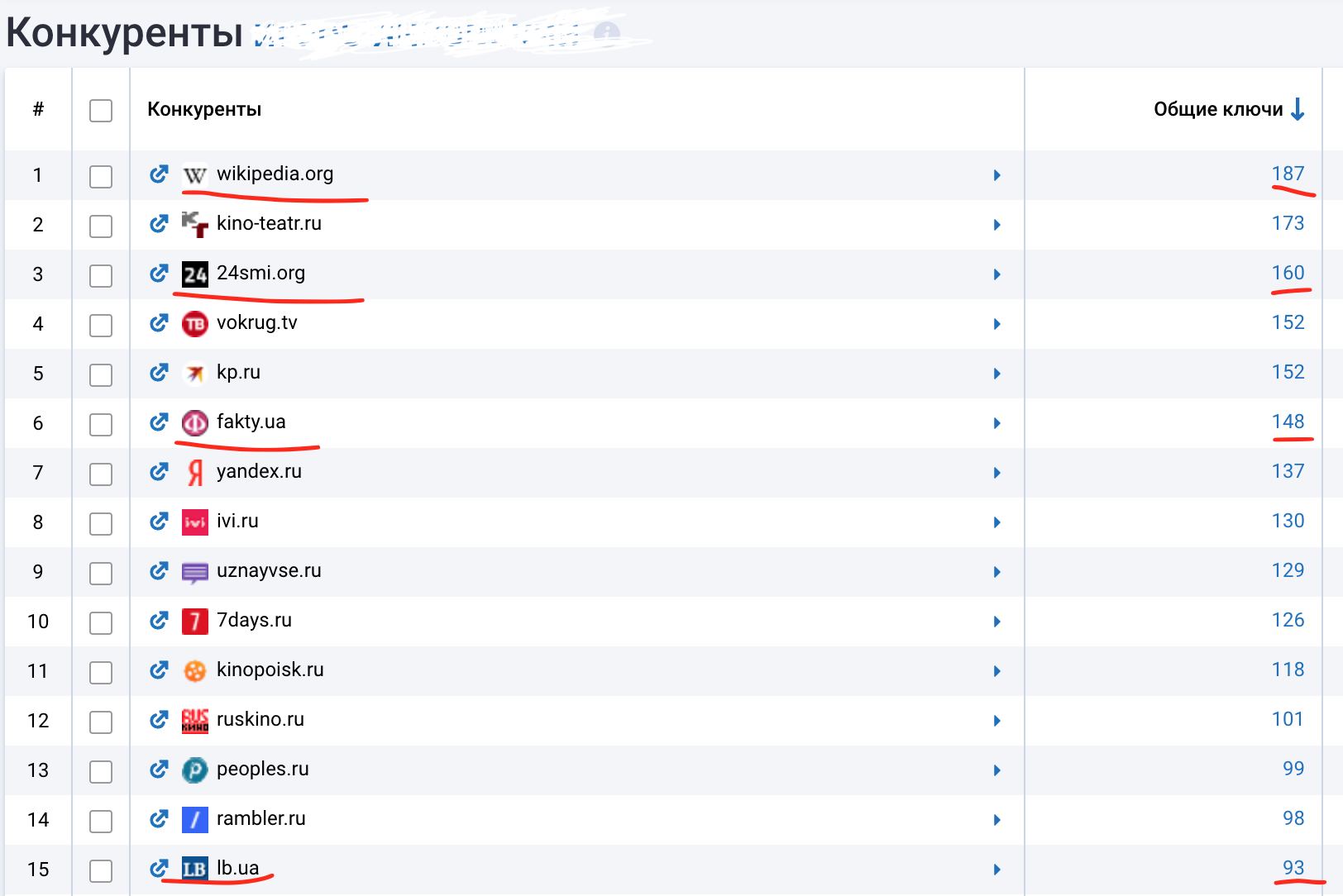

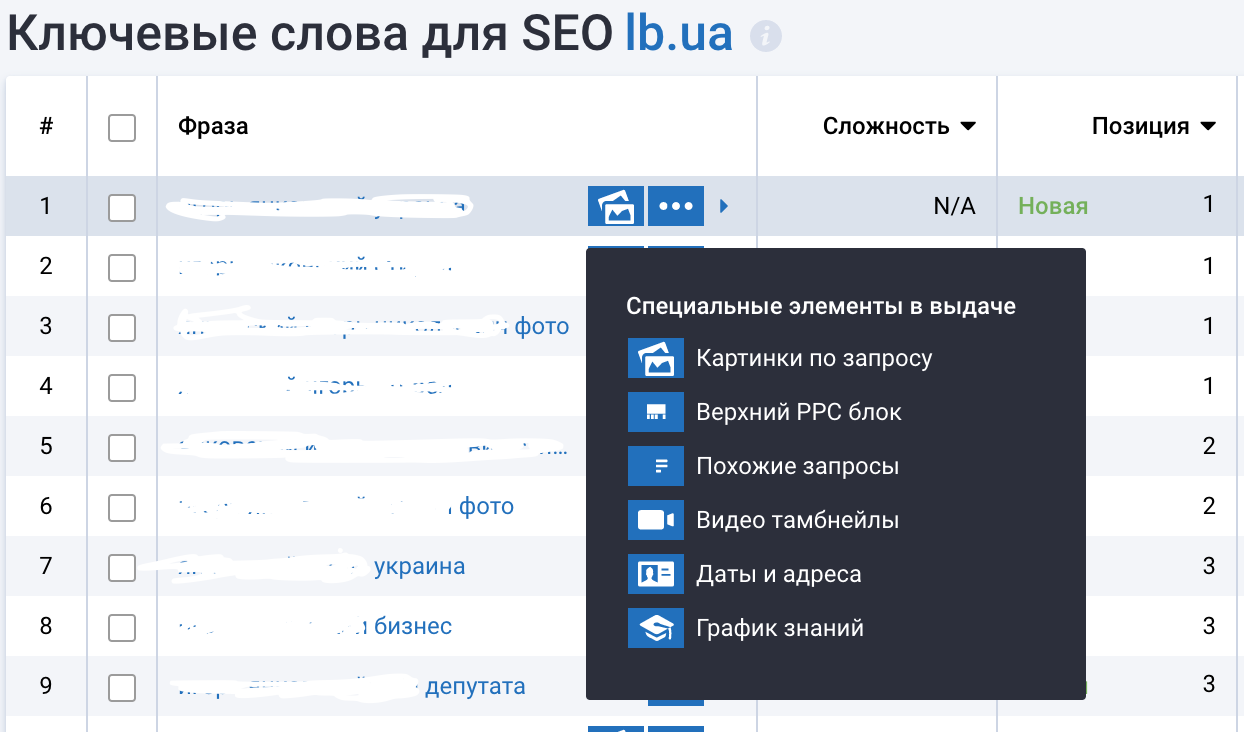

Также анализируем конкурентов по основной ключевой фразе:

Анализ ссылочных доноров

Так я вычисляю сайты, которые между собой делают перелинковку и репосты одинакового контента.

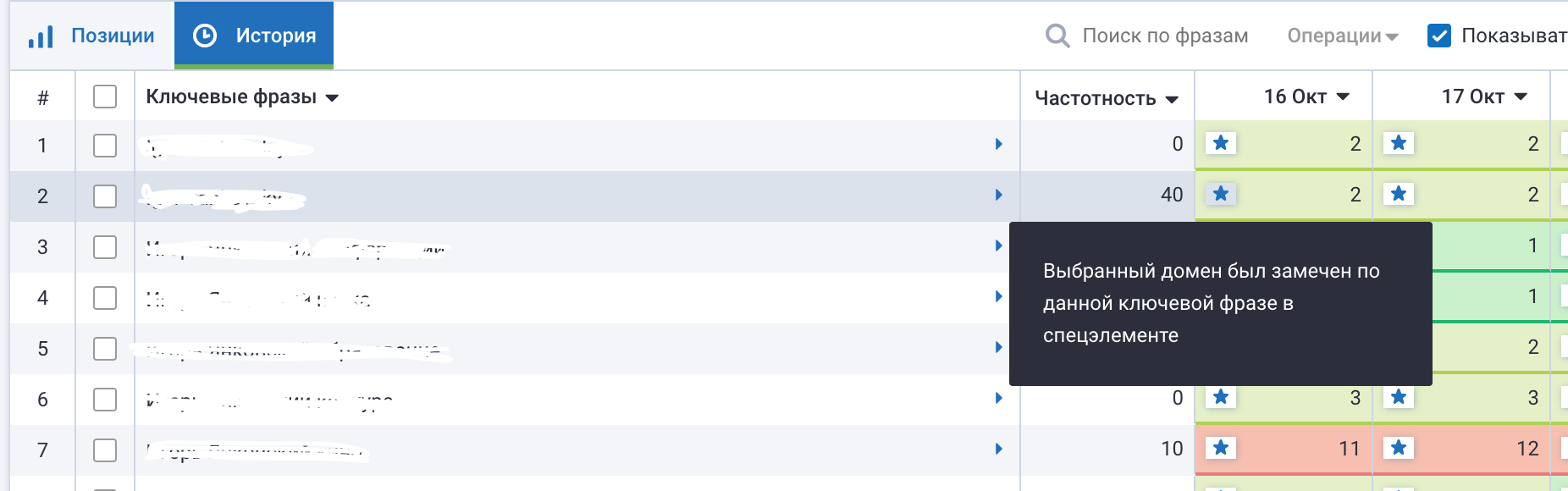

Мы также заносим все найденные «белые» страницы в мониторинг Serpstat, оцениваем их вес, уточняем места в выдаче и конкурентность по сравнению с черной выдачей.

Ведь если у нас 100 сайтов на старте с негативным оттенком и 5 с позитивным, значит, нам надо 5 сайтов не только сопровождать и наблюдать, но и придумать способы их продвижения, не имея при этом доступов к изменениям на сайте и изменению контента.

Через 2−3 месяца, если мы все делаем правильно, у нас может быть уже 10 сайтов с белым оттенком, которые нужно также как-то двигать в противовес с черным. Вот такая интересная работа :)

Заказывайте бесплатную персональную демонстрацию сервиса, и наши специалисты вам все расскажут! ;)

Составление плана противодействия

Чаще всего при работе с репутацией, нам приходится добавлять в проекты несколько десятков новостных ресурсов, чтобы отслеживать динамику показателей по нашим ключам. Каждый новостной ресурс может иметь сотни тысяч страниц и 2−5 млн ключевых слов, среди которых есть наши 10−20 шт., по которым мы устанавливаем наблюдение.

Теперь о результатах

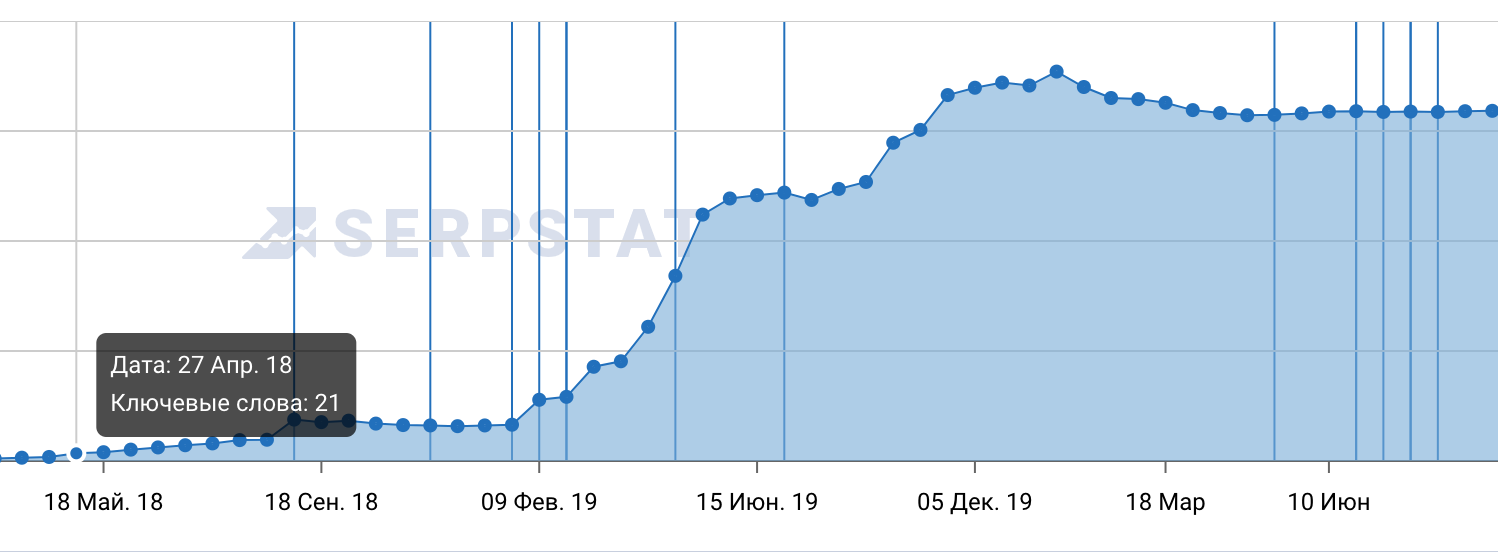

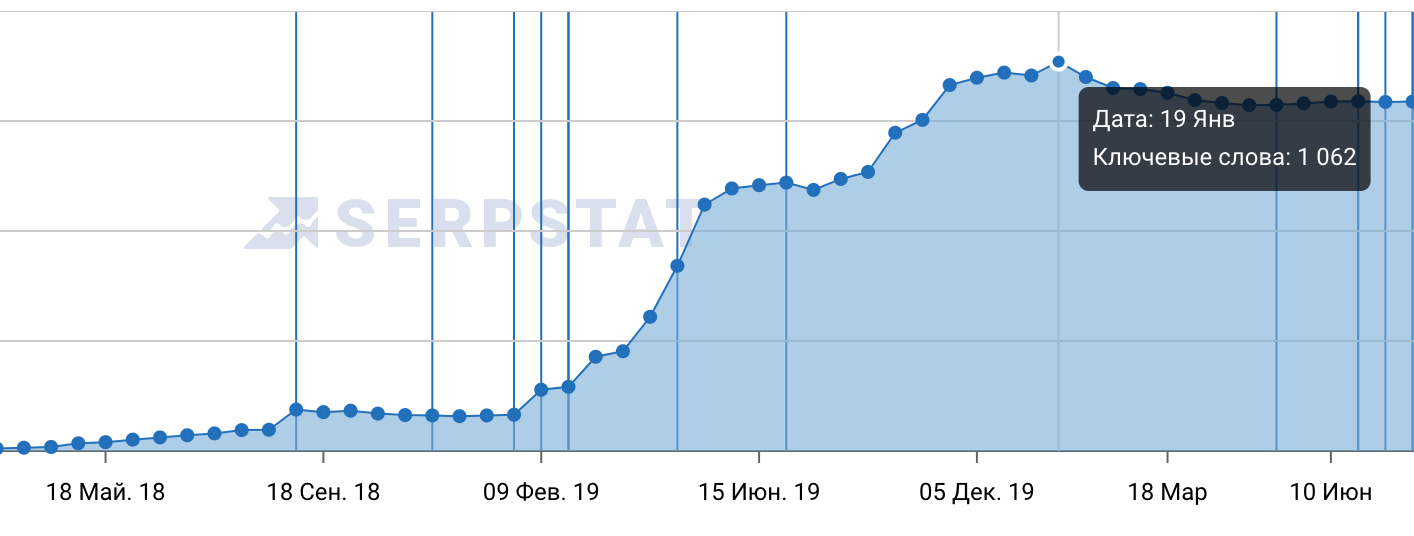

Проекты длятся долго, в случае ТТ первые результаты были уже (или только) через 3 месяца. Правда, половина результатов оказались временными, но это проделки алгоритмов)). На этапе создания кампании противодействия мы создали с нуля сайт — личный блог нашего ТТ и его наполняли контентом, каждый из которого должен был противодействовать негативным статьям в сети. На скриншоте ниже результат работы с этим сайтом, созданным с нуля.

Так вот результата в 95% позитива мы достигли только через 1,5 года. На протяжение которых у нас постоянно появлялся новый негатив, на который нам нужно было сразу реагировать и принимать меры, поэтому выходных у нас нет :)Результат крепкий и надежный, как стена на страже репутации. И на сегодня, чтобы попасть в топ-10 выдачи по ключу с негативом для ТТ будет очень сложно, так как путем 1,5 годичного ежедневного анализа, мы вывели в топ самые твердые страницы и усилили их различными способами.

Работая со ссылочной массой на наш основной домен (личный блог ТТ) — это было похоже на гонку на опережение :)

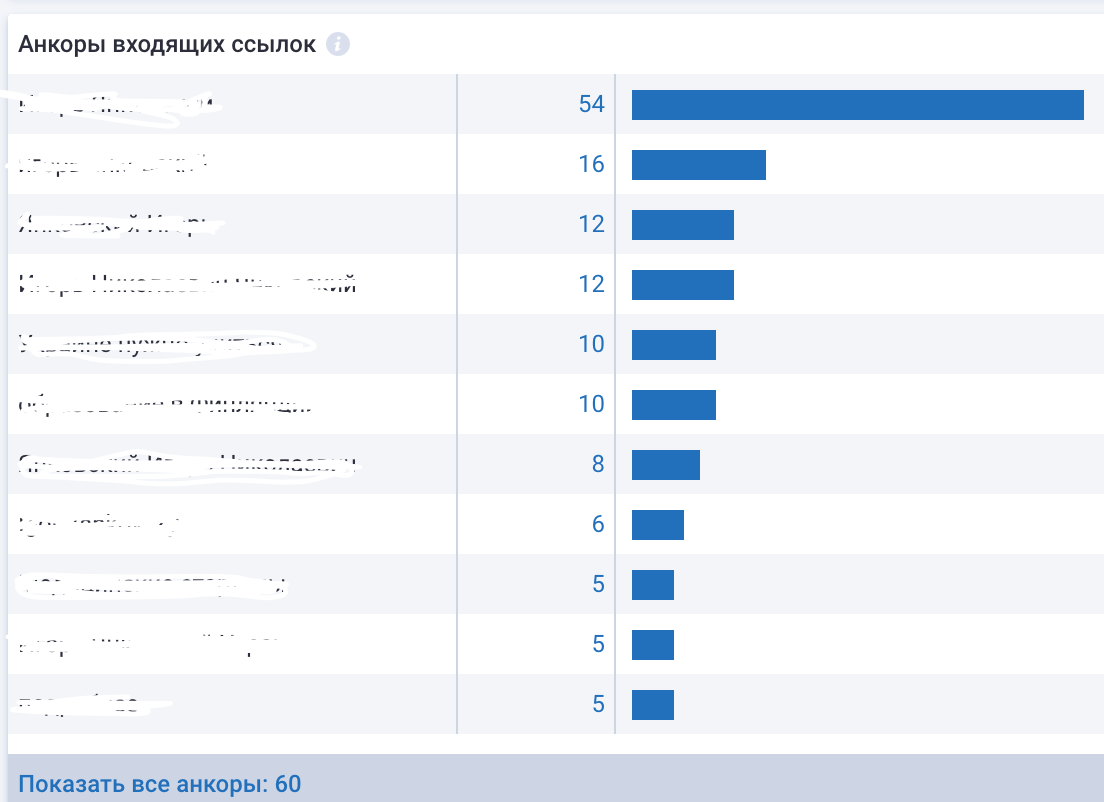

Как только мы получали сигнал о том, что появился негатив в сети, мы изучали страницу — сразу прописывали, какие анкоры использовали «черные ПиАрщики», в тот же день выкатывали статью на основном сайте, где использовали все способы разметки, а также размещали на сторонних площадках свежие, написанные час назад статьи с учетом обнаруженного анкора на негативной статье.

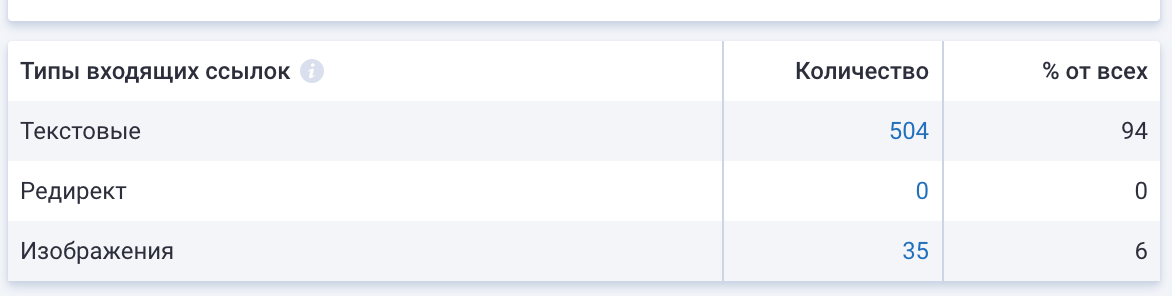

Размещение на других площадках всегда длилось чуть дольше, так как нужно было согласовывать размещение и ждать проверки вебмастеров. Самое важное в этом — быстрая реакция, быстрый ответ и «вес» размещенных нами статей должен быть всегда больше, чем размещенный в негативной статье. Для этого мы проводили анализ и сайта и статьи, ставили наблюдение на появление ссылочной массы на эту новую статью, дабы понять уровень «разгона».

Вот представьте себе — добавить в Serpstat 20 новостных ресурсов (на некоторых из них 2−5 млн ключей), прописать под каждый из проектов (сайтов) наши ключи и мониторить после каждого апдейта места в выдаче. При этом не забывать мониторить ссылки на эти статьи, упоминания в соц. сетях и блогах. И, если мы видели рост того или иного ключа (с негативным оттенком) — то мы сразу углублялись в технический анализ этой статьи, изучали причины роста и создавали противодействие в виде нашего контента, наших статей и усиления уже опубликованных статей с позитивным оттенком.

Это кропотливая работа, но она себя окупает во всех случаях, особенно, если человек публичный и от его репутации зависит успешность его бизнесов и проектов и доверия партнеров.

Serpstat — набор инструментов для поискового маркетинга!

Находите ключевые фразы и площадки для обратных ссылок, анализируйте SEO-стратегии конкурентов, ежедневно отслеживайте позиции в выдаче, исправляйте SEO-ошибки и управляйте SEO-командами.

Набор инструментов для экономии времени на выполнение SEO-задач.

Используйте лучшие SEO инструменты

Анализа домена

Узнайте о сильных и слабых сторонах любого сайта используя анализ домена

Проверка индексации

Узнайте какие страницы сайта не участвуют в выдаче используя инструмент проверка индексации

Мониторинг позиций

Отслеживайте изменение ранжирования запросов используя мониторинг позиций ключей

Анализ конкурентов

Сделайте полный анализ сайтов конкурентов для SEO и PPC

Рекомендуемые статьи

Кейсы, лайфхаки, исследования и полезные статьи

Не успеваешь следить за новостями? Не беда! Наш любимый редактор подберет материалы, которые точно помогут в работе. Только полезные статьи, реальные кейсы и новости Serpstat раз в неделю. Присоединяйся к уютному комьюнити :)

Нажимая кнопку, ты соглашаешься с нашей политикой конфиденциальности.